一个真实的故事:从日均3万IP到归零的47天

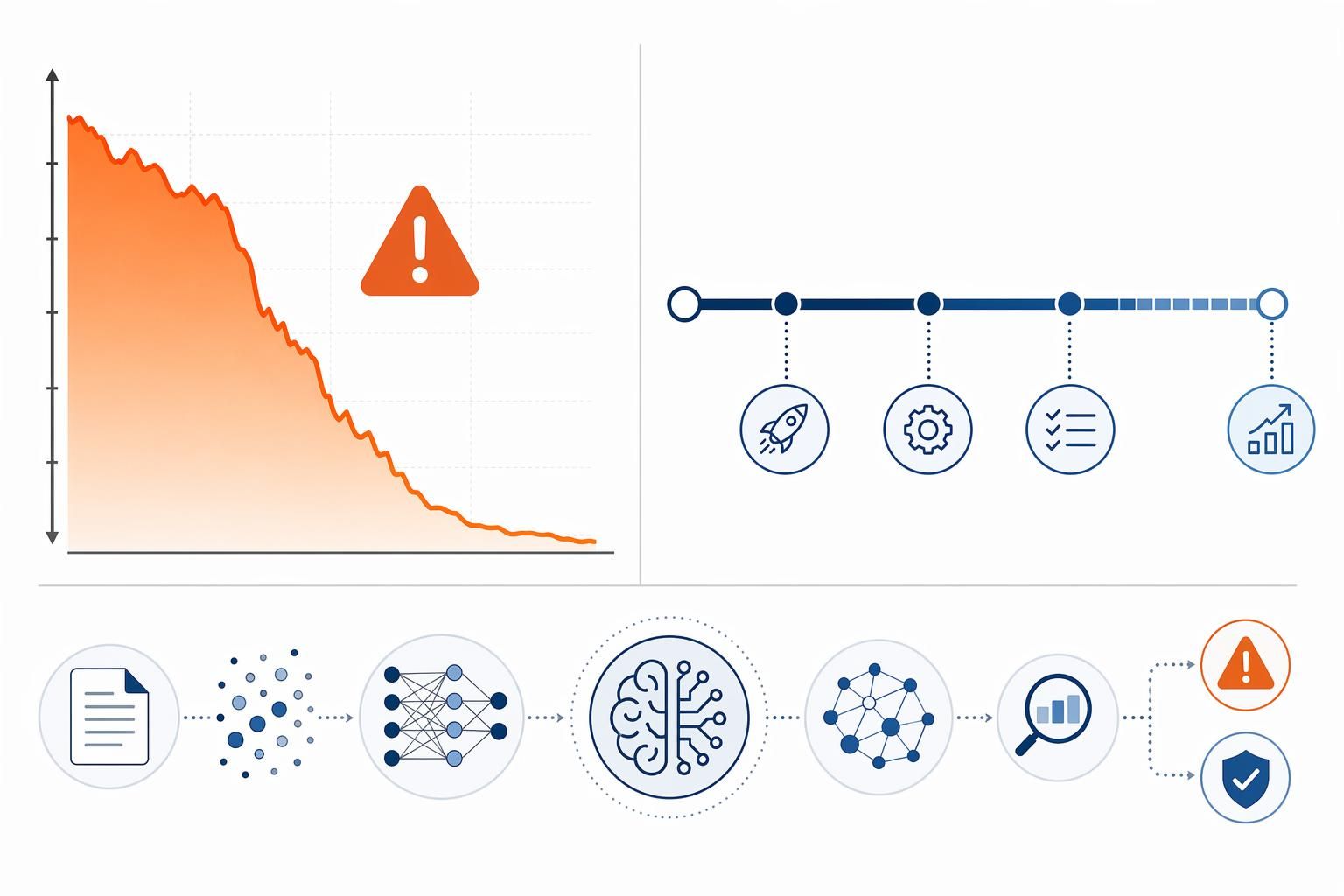

去年四月,我收到一条微信,发信人是做数码评测的老张。他只发了五个字:“全站凉了,救我。“配图是Google Analytics的截图——日均IP从3万断崖式跌至47,时间跨度正好47天。这不是算法误伤,而是2024年3月那场Google核心更新的标准结局。

那场更新从3月5日持续到4月19日,整整45天,是Google历史上耗时最长的一次核心算法调整。我亲历过2018年的Medic Update,也熬过2021年的Page Experience,但45天的部署周期前所未见。更关键的是,这次不是简单的信号权重调整,而是Helpful Content系统被正式整合进核心排名系统——这意味着针对低质量AI内容的清除不再是独立模块的”课外活动”,而是成为了排名算法的核心逻辑。

老张的网站正是典型的受害者。他在2023年底用AI工具批量生成了800篇“最佳性价比耳机推荐“,每篇结构工整、关键词密度完美,但没有任何实测数据,没有真实的佩戴体验,甚至没有拆开过包装盒。这种内容在旧算法下或许能靠信息堆砌蒙混过关,但在新系统中,算法通过神经网络特征检测识别出了文本的模式化特征——过于完美的H2标题层级、缺乏人类经验波动的叙述节奏、零瑕疵的语法结构反而成了“非人类创作“的证据。

你以为这是两年前的旧事?不,风暴刚刚升级。

2026年2月5日,Google启动了首次针对Discover功能的专属核心更新,2月27日才完成部署,历时22天。这次更新后,美国Discover Top 1000中的独立域名数量从172个锐减至158个,头部集中效应进一步加剧。算法不再只是惩罚明显的垃圾内容,而是开始系统性降低“缺乏深度和专业性的AI内容“的曝光门槛——哪怕你的文章语法正确、信息准确,只要它读起来像是从训练数据里平滑插值出来的,而不是从真实世界的摩擦中打磨出来的,索引优先级就会被打折。

老张后来花了三个月人工重写核心文章,加入真实的频响曲线测试和佩戴痛点描述,流量才恢复到原先的40%。这个案例不是终点,而是一个开始——从2024年3月到2026年2月,搜索引擎对AI内容的态度经历了三次关键转折,每一次都在抬高内容准入的门槛。如果你还在用2023年的AI内容策略运营网站,接下来要面对的可能不只是流量下滑,而是信任预审机制下的索引拒绝。

2024到2026:搜索引擎对AI内容态度的三次转折

老张的案例不是孤例。从2023年9月到2026年2月,搜索引擎对AI内容的态度完成了三次关键的转折升级。这不是平缓的迭代,而是三次精准的政策性定向爆破,每一次都重新划定了内容赛道的生存界限。

第一个转折点发生在2023年9月:系统识别AI内容,从“能否被发现”到“是否该被降权”。

那轮Helpful Content Update(HCU)让不少内容站长至今心有余悸。我当时观察的一个小型科技博客,流量一夜之间蒸发了60%。Google在这次更新中,首次大规模部署了识别AI生成内容的能力,并将其系统性地列为低质量信号。更重要的是,它同期推出了SGE(Search Generative Experience)的测试版——搜索结果顶部的AI摘要框开始直接生成答案。这两件事同时发生,信号再清晰不过:Google自己用AI直接回答用户问题,那么作为竞争对手的、那些为了排名而生的低质AI内容,还有什么存在的价值?算法的目的从帮你“被发现”,变成了判断“你是否值得被发现”。从那一刻起,AI内容的游戏规则,彻底变了。

第二个转折点以2024年3月和5月的两次更新为标志:从“识别”到“清除”,态度从审判官变为清道夫。

如果说2023年9月更新是“挂牌警告”,那么2024年的动作就是“拆除违建”。3月那场长达45天的核心更新,Google公开宣布其目标是减少40%的低质量内容,结果实际减少了45%。帮助原创内容(Helpful Content)这套标准,从独立的评分系统被整合进了核心排名算法。这意味着对AI内容的打击不再是“附加题”,而是“必答题”,融入了搜索排名的每一次计算中。

紧接着,5月5日,Google推出了专项的“打击AI垃圾更新”。这次更新的官方表述非常直白,将打击目标明确为“主要为提高搜索排名而产生、缺乏原创价值”的AI内容。这等于给大量“伪原创”的AI水军判了死刑。算法不再纠结于你的内容“是不是AI生成的”,而是判断你的动机——“你是不是为了骗我的排名而生的?”这是一个根本性的视角转变。

第三个转折点,从2025年贯穿至2026年初:从“内容是什么”到“内容来自谁”,信任与经验成为硬通货。

经历了两轮清洗,剩下的AI内容“幸存者”多少都经过了人工润色。于是,2025年的核心更新,聚焦于更深层的问题:谁来为这份“润色”背书?E-E-A-T原则中的“经验”(Experience)维度被提到了前所未有的权重。算法开始精细地区分“关于某事的理论综述”和“做过某事的经验分享”。一篇由AI生成、再由编辑添加了几个“笔者认为”的文章,和一篇由从业者口述、充满细节、错误和真实体感的文章,在算法眼中已是天壤之别。

这种对“一手经验”的渴求,在2026年2月的Discover更新中达到了新高度。这是Google首次为Discover信息流发布专属核心更新,目标精准:打击耸动标题,优先展示深度原创。结果?更新后,美国Discover Top 1000的独立域名从172个缩减到了158个。流量进一步向那些能产出真实、深度、专业内容的头部站点集中。算法在信息流这个更强调“吸引”而非“检索”的场景里,依然对缺乏深度的AI内容关上了大门。这说明,对高质量、高信任度内容的追求,已成为贯穿Google所有产品线的统一意志。

这三次转折,脉络清晰:从技术识别(2023),到动机清算(2024),再到信任验明(2025-2026)。每一次都不是小修小补,而是对上一轮“漏洞”的封堵和对标准的再次拔高。老张们的故事,正是在这层层收紧的大网中必然发生的结果。

那么,走到2026年的今天,Google到底用一套怎样的新规则,在索引阶段就筛掉那些“不合格”的AI内容?这套新规则,就是决定你网站生死的三个核心变化。

2026年索引策略的三个核心变化

如果说前面的升级是“层层加码”,那么2026年今天正在发生的这三个变化,则直接把筛选机制嵌入了索引流程的最前端。它们不是修补,而是重建。

变化一:AI内容过滤机制升级——从“是不是AI”转向“有没有价值”

这是2025年最隐蔽也最致命的一步。很多站长还在纠结“Google能不能检测出我用了AI”,却不知道这个问题已经过时了。

2025年的核心更新中,Google部署了一套新的检测系统,不再执着于文本的AI特征,而是专注于内容本身的“神经多样性”。所谓神经多样性特征,本质上是算法对内容模式化程度的感知能力——当它发现一篇文章在结构、措辞、论证逻辑上呈现出高度的算法一致性时,就会自动贴上“低价值模式化内容”的标签。简单说,Google现在关心的不是你用什么写的,而是你写的东西有没有“人味”。

这种判断维度的切换意味着什么?意味着即使你用最先进的AI工具、用最自然的语气、甚至找native speaker帮您校稿,只要内容本身缺乏独特的认知结构、缺少区别于同类文章的差异化价值,就可能在索引阶段被直接过滤,连进入排名竞争的机会都没有。这不是玄学,这是2025年算法更新后大量网站流量骤降的真正原因。

变化二:信任预审机制前置——索引排队前先验明身份

如果说变化一是内容质量的审判,变化二则是对内容生产者身份的审查。

2025年开始,Google对新页面的索引策略做了根本性调整:信任预审机制被前置了。过去,一篇新内容发布后,通常在几天内就会被Google发现并尝试索引。现在的流程变成了:新页面提交后,会先进入一个信任度评估队列,只有通过验证的内容才会进入正式的索引排队。

这个机制的核心是E-E-A-T原则的实体化。更直白地说,Google现在要看“这篇文章背后有没有一个可信的人或机构愿意为此负责”。它能识别页面中嵌入的作者身份信息,比如学者的ORCID ID、机构 affiliation、行业认证等,并且会将这些身份信息与已知的高权威来源进行交叉验证。

一个已经被广泛讨论的案例是上海某医疗设备公司的实践。这家公司在其专业内容页面中嵌入了合著作者的ORCID学者签名和机构实体图谱。效果立竿见影:其新页面的平均索引耗时从此前的17天骤缩短至9小时。17天 vs 9小时,这个数字对比已经把Google的态度说明白了——它不是在惩罚AI内容,它是在奖励那些愿意“用真实身份为内容背书”的玩家。

变化三:新鲜度因子权重飙升——静态内容快速贬值

第三个变化也许是最隐蔽的,因为它不针对内容质量本身,而是针对内容的“生命周期”。

2025年,Google算法中“新鲜度因子”的权重已经飙升至35%。这不是一个可忽略的边缘指标,而是核心排名参数之一。它的核心逻辑是:内容是有“保质期”的,特别是那些基于数据、事实、时效信息的AI生成内容,如果在发布后没有与真实世界保持同步,就失去了“解决用户问题”的能力。

这直接宣判了“一劳永逸式”AI内容策略的死刑。过去那种用AI批量生成一堆“常青内容”然后放任不管的做法,现在面临两个致命问题:一是当同类内容在搜索引擎中供过于求时,算法必然优先展示持续更新的版本;二是Google已经具备了识别“内容是否与后台数据保持同步”的能力。一个产品详情页的价格还是发布时的旧价格,一篇文章引用的数据还是去年甚至前年的统计——这些细节在2026年的索引评估中都会被捕捉。

这意味着,AI内容创作的工作流必须与数据后台打通。CMS与业务系统的API自动对接不再是“加分项”,而是“必选项”。只有能够实时同步变化的数据(如价格、库存、技术参数、行业动态)的内容,才可能在2026年后的搜索环境中获得持续流量。

这三个变化叠加在一起,构成了2026年AI内容索引策略的完整图景:算法不仅在评估你写得好不好,还要验明你是谁、值不值得信任,以及你的内容有没有在“活着”。这不是危言耸听,这是正在发生的事情。

这些变化正在怎样影响你的网站?流量、排名、工作方式——具体的影响,我放到下一章细说。

这些变化正在影响你的网站

这些变化不是停留在算法公告里的技术文档,它们正在以具体而残酷的方式,重构你网站的流量曲线。

最直接的冲击来自用户行为数据。Google现在把页面停留时间和跳出率当成了索引准入的硬指标。数据显示,停留时间低于10秒的内容,其在Google首页的留存率不到15%;而一旦跳出率超过65%,排名下降的风险会陡然提升40%。这意味着什么?意味着即使你的文章通过了信任预审,躲过了神经网络特征检测,只要用户点进去三秒就离开,Google会立即判定这是一篇“不值得索引“的内容。AI生成的模式化内容往往呈现这种特征:标题党骗点击,正文空洞无物,用户扫一眼就走。这种内容在2026年的索引策略下,连被收录的机会都在快速萎缩。

技术性能门槛同样在收紧。移动端加载速度低于3秒已经成为硬性指标,超过这个阈值,50%的用户会直接离开。这对WordPress站点尤其棘手——很多站长沉迷AI批量生成内容,却忽略了图片压缩、CDN加速、冗余脚本清理。当你用AI一天生成50篇文章时,有没有检查过这些页面的首屏加载时间?在内容供过于求的今天,技术性能缺陷会直接触发索引降权,因为Google认定“连基本用户体验都无法保障的内容,不配获得排名“。

更隐蔽但致命的是E-E-A-T原则中“经验“维度的权重飙升。超过60%的SEO从业者观察到,展示作者真实经验和行业背书对信任度提升效果显著。这不是简单的署名,而是需要可验证的专业身份—— ORCID学者ID、行业认证、实体机构 affiliation。纯AI生成的内容缺乏这种“人的痕迹“,在信任预审机制前置的背景下,面临索引困难或排名持续下降几乎是必然结局。我见过太多案例:网站内容更新频率没变,索引量却在逐月下滑,根源就在于算法识别出这些内容“没有人为之负责“。

内容新鲜度因子权重升至35%的影响也在显现。静态的、一次性生成的AI内容正在快速贬值。如果你的产品页价格还是三个月前的数据,如果你的行业分析引用的是去年的统计,Google会判定这篇内容已经“死亡“。2026年的索引策略要求内容必须保持“生命状态“——与后台数据实时同步,持续更新迭代。那些指望用AI批量生成“常青内容“然后放任不管的站长,正在经历索引量断崖式下跌的阵痛。

这些影响不是预警,是正在发生的现实。你的索引量在下降吗?你的新页面收录速度是不是越来越慢?你的排名是不是在不明原因地波动?如果答案是肯定的,那么你已经站在了需要改变的十字路口。

但这不是绝境。既然我们知道了规则,就能找到合规的路径。接下来的问题只有一个:面对这些影响,WordPress站长应该怎么做?

被验证有效的合规策略

既然Google已经摆明了态度,那就不要再问“AI内容还能不能做”——真正的问题是,在2026年的规则下,我们到底该怎么合规地做。

方法不是去对抗算法,而是去理解它背后的意愿:Google希望内容能真正解决问题,背后要有真实的人类判断。于是,最有效、也是被反复验证的方法,是在AI与人之间建立一种紧密的共生关系,我称之为“Cyborg模式”。这不是简单地说“AI写稿,人校稿”,它是一个严谨的三阶段工作流。

第一阶段:AI生成内容骨架(毛坯房)

用AI(比如DeepSeek或通过鸭梨AI写作这类工具接入的模型)基于指令生成初稿。这一步的目的是解决“写不出”和“写得慢”的问题,快速搭建信息的逻辑框架和结构。记住,这时候产生的只是“毛坯房”,你绝不能直接把它推向世界。

第二阶段:行业专家注入专业洞察(钢筋混凝土)

行业专家必须介入。其任务不是改病句,而是做三件事:第一,检查和修正所有技术参数、统计数据的准确性;第二,基于自身行业经验,加入AI无法凭空生成的洞察,例如“这个新政策对中小卖家的供应链实际影响会是滞后的”;第三,识别并剔除缺乏实践支撑的空泛论断。这是内容从“信息堆砌”转向“行业解决方案”的核心一步。有一家外贸建站服务商严格执行此流程后,其内容的原创性评分提升了85%。

第三阶段:用户体验设计师重构表达(精装修)

最后一步交给懂用户体验的设计师或内容创作者。其核心使命是“去AI腔”,让内容读起来像人写的,甚至像老朋友在分享。这意味着增加真实使用场景、补充具象故事、调整句式节奏、插入视觉锚点(如图表、对比),最终让用户愿意停留3分钟而不是10秒。经过这三重人工“镀金”,一篇由AI驱动但拥有“人类灵魂”的内容才算完成。

这个工作流之所以有效,是因为它精准回应了索引策略的三大变化:专家编辑对应“信任预审机制”,用户体验改造对应“用户行为数据门槛”,持续的优化迭代则关联“内容新鲜度因子”。

接下来你要解决身份的信任问题。谷歌的算法越来越像一个专业的HR,它在评估你的“简历”。一篇纯AI生成的内容,就像一份没有推荐人、没有工作经历的空白简历,会被直接扔进垃圾桶。你必须为内容绑上可验证的人类专家身份。

最值得投入的方法是绑定学术和研究身份,比如在文章页面的JSON-LD结构化数据中嵌入作者的ORCID(开放研究者与贡献者身份)ID。上海某医疗设备公司的案例极具说服力:当他们在网站中为内容绑定ORCID学者签名和机构实体图谱后,新页面的平均索引时间从17天缩短至9小时。这个事实揭示了搜索引擎的新逻辑:它不再仅仅相信“你是谁说的”,而是通过可验证的凭证来相信“你为什么有资格说”。

对于非学术领域,同样有方法。展示具体的行业认证(如PMP、CFA)、绑定公司实体百科词条、甚至是在作者简介中链接到可查证的、有历史活跃度的社交媒体账号。这些“人类痕迹”就像为你的内容盖上了权威的印章,是绕过“信任预审”中身份审查关卡的通行证。

但仅有身份还不够。2026年的算法已经进化到能评估内容的“含人量”——即内容中有多少比例是AI无法生成的独家信息。数据表明,人工加入约20%的独家信息,就能带来显著的排名提升拐点。

这20%从哪来?它必须是真正有价值、源于人类实践的“血肉”。我给你四个明确的采集方向:

增加实测数据与对比。

AI可以告诉你“某款洗地机吸力为18000Pa”,但如果你实测后发现,在长毛地毯上它的实际清洁效率下降40%,这个数据就是你的独家资产。增加一张你自己测绘的性能曲线图,或一个与竞品的实际功耗对比表,这篇内容的价值维度就完全不同了。

补充独家行业洞察。

AI能汇总新闻,但它无法告诉你“由于东南亚供应链转移,深圳的模具厂正在经历一轮结构性的价格调整”。这类来自一线从业者饭局、行业小圈子交流的“水温”,是AI永远无法触及的。把它写出来。

重写以摆脱模式化的“AI腔”。

仔细审视AI初稿的句式。有没有那种“综上所述……”,“值得注意的是……”的刻板总结?有没有那种面面俱到但毫无重点的八股结构?用你自己的话,从用户的实际困惑出发,像聊天一样重写它。让文章有“呼吸感”。

提供可直接复用的资源。

AI可以写教程,但无法提供一个经过真实项目验证、你亲手调试无误的SOP模板、Python脚本或合同范本。把这些资源作为附件或直接展示核心代码片段,内容的实用性将急剧飙升,用户停留时间和分享率自然会水涨船高。

这套“20%法则”的本质,是在告诉搜索引擎:这篇内容不是在复制已知信息,而是基于人的经验和实践,创造出了新的解决方案。这正是2026年“Helpful Content”的内核。

最后,这些策略不是孤立的,它们需要整合进你的日常操作中。这意味着你必须告别“一键生成,一键发布”的旧习惯,建立起一个包含策划、生成、深度编辑、技术优化和持续更新的系统性流程。这个过程需要合适的工具来润滑协作,降低执行门槛。例如,如何高效地管理这样一个涉及多角色的写作流程?如何确保初稿质量足够高,以减少专家的修改成本?这恰恰是下一阶段我们会聚焦的问题。

用对工具,效率和质量可以兼得

前面说的Cyborg模式、专家身份绑定、独家信息注入,这些策略听起来都对,但很多同行跟我说:“道理我懂,但操作起来太累了——选题靠手搜、关键词靠经验写,AI工具换来换去没一个趁手的,一套流程跑下来比纯手工还折腾。”

这确实是现实问题。策略再好,执行成本太高就会让人放弃。与其给你推荐具体工具,不如先告诉你选工具的底层逻辑——这样你至少知道什么叫“选对了”,而不是被人牵着走。

2026年的工具筛选逻辑

Google和百度对AI生成内容的态度,已经从“你能不能用”变成了“你怎么用”。两家的识别机制不同,导致选工具的侧重点也不同。

Google的索引策略我上一章已经拆过,它的核心逻辑是**“含人量”——你得让人看出内容背后有真实的经验和判断。所以工具选对了,帮你省的是初稿的体力活;工具选错了,它生成的完美废话反而会成为信任负债。

百度的思路不太一样。它对实时性和中文语义的颗粒度要求更高,2026年的“AI辅助内容”判定更多依赖意图识别和实体关联**。这意味着在百度这边,你的工具能不能帮你植入独家数据、供应链一线观察这类“百度百科没有的东西”,比文笔本身更重要。

基于这两套逻辑,我给你三个筛选维度:

第一,看工具是否支持分阶段介入。 真正的Cyborg模式不是让AI一股脑写完,而是允许你在“骨架生成”“专家介入”“去AI腔”三个阶段分别调动工具能力。那些号称“一键生成爆款”的工具,大概率不适合这种工作流。

第二,看工具的SEO能力是否足够本地化。 这里说的不是首页关键词密度,而是长尾词拓展、语义向量优化、GSC数据回传这些底层能力。百度尤其吃这一套——如果你发现某个工具只能给你一组关键词,但给不了这些词在整个内容矩阵中的语义坐标,那它的SEO价值要打个问号。

第三,看工具的“去AI腔”能力。 直接决定你的内容会不会死在2026年的索引门槛前。这一步目前没有工具能完全替代人工,但它可以帮你做第一遍筛查——把那些“综上所述”“值得注意的是”这种模式化表达标出来,让你的编辑知道从哪里下手。

把这三个维度放在一起去评估市面上主流的AI写作工具,你会发现大多数工具都有明显的功能偏向——有的强在选题,有的强在批量生成,有的强在SEO优化。真正能完整覆盖三个维度的,我用下来觉得鸭梨AI写作是目前把“AI效率”和“人工把关”融合得最顺畅的一个。它的智能主题引擎能帮你从关键词联想、竞品分析、热点捕捉多角度批量产出可执行选题,双轨写作模式能分别匹配标准批量生成和深度人工协作的场景,内置的SEO工具链和改写润色功能也能支撑“去AI腔”的第一轮操作。

但我要说的是:工具只是润滑剂,不是发动机。你真正该花时间做的,是把Cyborg模式固化到日常工作中。我的建议是:选题阶段让工具帮你跑出带关键词建议的选题库;初稿阶段用工具快速出骨架;人工编辑阶段用SEO工具检查关键词密度和语义完整度,同时用改写润色功能做第一轮“去AI腔”;最后用数据洞察持续跟踪内容表现。

这个流程跑顺了,工具才能真正帮你兼得效率和质量。

2026年WordPress站长的行动清单

前面我们聊了鸭梨AI写作工具怎么嵌入Cyborg模式,但工具只是武器,打仗还得看战术。2026年的AI内容索引策略已经收紧,信任预审机制和神经网络特征检测正在运行,你的网站可能已经被标记了只是还没收到通知。

别等了,这份清单是你接下来48小时必须完成的动作。

第一步:给存量内容贴人皮

打开你的WordPress后台,逐篇检查过去6个月发布的AI辅助内容。每篇文章必须绑定可验证的人类身份——不是随便写个“张三“,而是带ORCID链接的学者档案、带LinkedIn背书的行业专家、或带机构实体图谱的组织身份。没有作者信息的内容,算法默认是机器垃圾。

操作路径:文章编辑页 → 作者信息栏 → 添加外部身份链接 → 更新站点结构化数据。

第二步:把Cyborg模式焊进工作流

从今天起,禁止直接发布AI初稿。建立人机协作工作流的三道闸:鸭梨AI的标准模式出初稿(第一阶段)→ 行业专家注入实测数据和独家洞察(第二阶段,必须包含20%人工独家信息)→ 用深度模式或人工重写去除AI腔(第三阶段)。每道闸要有明确的责任人和交付标准。

第三步:技术性能生死线

打开Google PageSpeed Insights,测试你流量最高的10个页面。移动端加载速度高于3秒的,立即整改:图片压缩到100KB以下(用WebP格式)、删除阻塞渲染的JS、启用CDN。记住,2026年的索引策略中,跳出率高于65%的页面排名下降风险提升40%,而加载超时是跳出率的头号杀手。

第四步:API化你的内容

静态AI内容正在失效,因为内容新鲜度因子权重已升至35%。检查你的CMS是否接入了后台数据API:电商站点需要实时库存和价格同步,技术博客需要实时参数更新,新闻站点需要发布时间戳自动刷新。WordPress用户可以用WP REST API对接内部系统,确保关键数据变动时页面自动更新。

第五步:内容基因改造

针对已有排名但流量下滑的页面,进行人工深度改造:增加实测数据(跑分、功耗曲线)、补充供应链等独家洞察、重写开头300字去除“在当今数字化时代“等AI腔模板、添加可下载的SOP模板或脚本话术库。目标是让E-E-A-T原则中的“经验“维度肉眼可见。

完成这五步,你的网站才算在2026年的AI内容围剿中拿到了豁免权。拖延的代价是索引队列中的永久靠后——搜索引擎不会提醒你,它只会让你的流量在47天内归零。

现在开始动手。