那个被官方否认的权重,正在以新方式回归

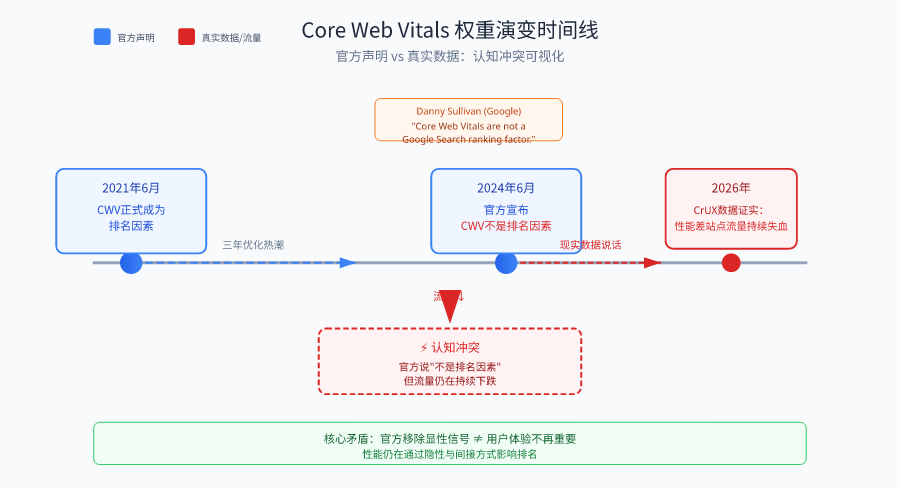

2024年6月,Google搜索联络官Danny Sullivan在X平台上敲下了那句终结一个时代的宣告:“Core Web Vitals are not a Google Search ranking factor.” 翻译过来就一个意思:别再把LCP、FID、CLS当成你的KPI了,它们和你的搜索排名无关了。

这话如同一桶冷水,浇在了自2021年6月以来为这三个指标绞尽脑汁、投入无数开发资源的网站所有者头上。三年,整整三年。我们被告知用户体验是新的货币,而Core Web Vitals就是那把标尺。可现在官方自己却说,这尺子不量排名了。

但奇怪的事情发生了。

2026年的今天,数据不会撒谎。你打开Search Console,翻看CrUX报告,或者直接看看你的Analytics数据线。那些性能评分依然“差劲”的页面,它们的自然流量曲线还在持续失血。官方说权重已死,怎么用户的脚还在诚实投票?那些因为LCP飙升、INP卡顿而愤然离开的访客,他们带走的不是排名分数,而是真实的商业机会。

为什么?因为游戏的规则变了,但游戏的赌注没变,甚至更高了。官方移除了一个简单的、公式化的排名信号,不等于移除了用户对糟糕体验的厌恶,更不等于移除了Google自身搜索引擎生存的逻辑。一个让用户快速离开的网站,对任何想留住用户并提供价值的平台(包括Google自身)都是负担。

2024年6月那纸声明,改变的只是信号传输的方式。以前是显性的、直接的扣分,现在变成了隐性的、间接的过滤。它不是“不重要了”,而是“换了一种更聪明的方式继续重要”。

你真正的困惑在于:如果它不再是排名因素,那是什么在偷偷起作用?接下来的几章,我们会拆解2026年性能权重的新运作机制。你会发现,它不是消失了,而是渗透进了搜索的毛细血管里:从AI爬虫那个越来越没耐心的“第一印象”,到高价值用户那转瞬即逝的“第一秒耐心”,再到移动设备作为唯一“裁判”的冰冷现实。我们正从一个“优化指标以讨好算法”的时代,进入一个“服务真实用户以通过算法考验”的时代。

这矛盾就是2026年的现实:嘴里说着不重要,身体却很诚实。

2024年6月到底改变了什么,又什么都没变

但别急着把性能报告扔进回收站。在你冲动之前,先听我把2024年6月那纸声明拆得细一点。因为大多数人的理解,只对了一半。

Google搜索倡导者John Mueller后来在LinkedIn上补充的那段话,才是真正的重点。他说:“我们已经非常明确地表示Core Web Vitals不是排名中的巨大因素,我怀疑你会仅仅因为它们而看到大幅下降。”注意措辞——“不是巨大因素”,不等于“不是因素”;“不会大幅下降”,不等于“完全没影响”。他后面还补了一句更实际的:“如果用户感到厌烦以至于不想回访,你就浪费了首次访问者,不管他们从哪里来。”

这就是Google的微妙之处:它不是在说性能不重要,而是在说——如果你做得太烂,我可能还是会小小地踩你一脚,但别指望靠跑分就能超车。

真正被误读的关键在于:不是性能不重要了,而是Google不再用这三个具体数字作为排名开关。2021年那次是把LCP、FID、CLS做成了一个显性的打分牌,挂在你页面的脑门上;2024年这次是把这个牌子摘了,但不代表考核官走人了。换句话说,Core Web Vitals从“加分项”变成了“及格线”——你达不到,没人会专门为你扣分;但你达到了,也别指望有人因此给你发奖。

Search Engine Journal分析过一组数据很说明问题:Google的算法确实还在参考Core Web Vitals,但其影响已经从“可能大幅改变排名”变成了“影响15-25%有机流量的隐性变量”。换句话说,它从一把突击步枪变成了一套消音装置——杀伤力还在,只是你听不见枪声了。

这是2026年的现实:性能不再是让你鹤立鸡群的本事,但能讓你不至于被悄悄埋进搜索结果的第五页。

AI爬虫的耐心比人类还少,这正在重塑游戏规则

但2024年6月之后,性能的门槛没消失,只是换了裁判。我们以前只需应付一个裁判:Googlebot。它爬得慢一点、少一点,大不了索引晚两天,排名暂时不动。2026年的裁判席坐满了:Googlebot旁边,挤着OAI-SearchBot、Claude-SearchBot、PerplexityBot,还有一堆你叫不上名字的AI助手爬虫。

它们和Googlebot看你的网站,心态完全不同。

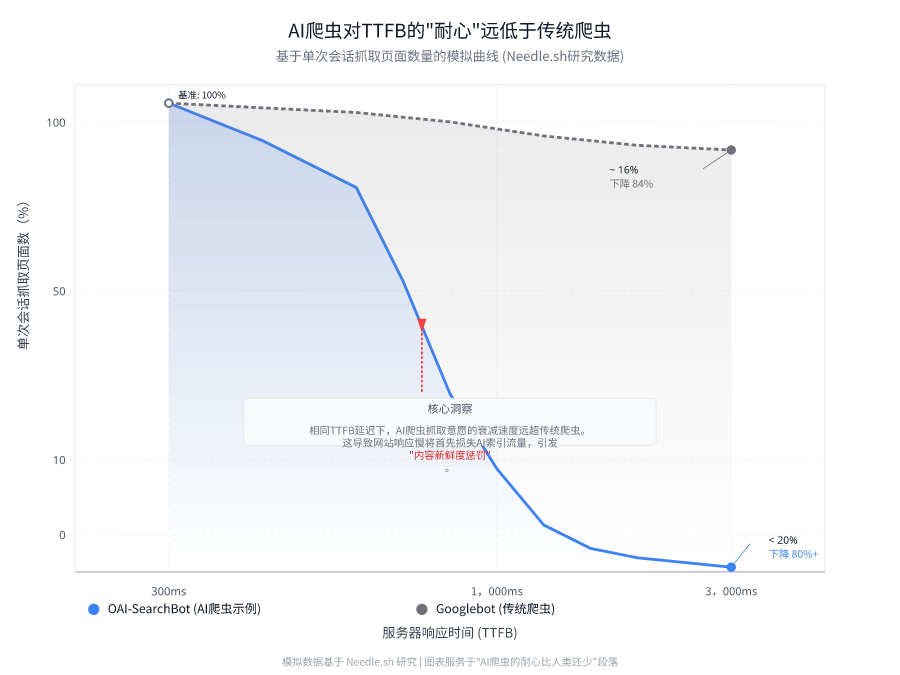

Googlebot的终极目标是建索引,把网页内容抄进自己的数据库。AI爬虫的目标是理解、压缩、然后重组你的内容,生成一个简洁的答案。这意味着AI爬虫对页面完整性的要求更低,但对响应速度的要求高到苛刻。它不需要等你页面上的所有JavaScript动画加载完毕,甚至不需要渲染出整个CSS布局——它只需要能快速解析出核心内容块的HTML。但如果连这个第一步都卡住了,它会毫不犹豫地离开。

这才是“爬虫预算”在AI时代的新含义:它不再是关于“能爬多少页”,而是关于“愿意在你身上花多少时间”。一个关键数据揭示了这种差距:根据Needle.sh的研究,当服务器的响应时间(TTFB)从理想的300毫秒恶化到3秒,面向AI的爬虫抓取的页面数量会急剧下降,甚至可能减少80%以上。

因为AI爬虫的“耐心预算”本质上是计算预算。在云端服务器上多等一秒钟,对OpenAI或Anthropic来说,都是烧掉的真实美金。它们训练模型时就已经学会了“效率优先”,所以它们的爬虫行为也遵循这个逻辑:快速获取信息,然后离开。

这对你意味着什么?意味着你的网站如果响应迟钝,在AI爬虫眼里就等于一座难以开采的贫矿。它不会慢慢挖,它会直接标记为“投资回报率低”,然后减少访问频率。

结果不是你的内容从索引里消失,而是当一个新的AI概述问题出现时,你的内容因为“不够新鲜”而错失被引用的机会。我称之为“内容新鲜度惩罚”。想想看:当用户问Perplexity“2026年春季最新的徒步鞋推荐是什么”,它需要立刻找到过去一两周内刚被索引的、包含新品发布信息的页面。如果你的新品页面因为TTFB长达3秒而没被OAI-SearchBot完整爬取,那么在你的服务器终于响应的那个时刻,爬虫可能已经因为超时或被其他任务抢占而跳出了。你的内容对AI来说,就成了“过时信息”。

我亲眼见过一个案例:一家垂直电商网站,2025年秋季上了一批新品露营装备。他们的SEO团队按照传统玩法,提交了站点地图,等着Googlebot来爬。一周后,产品页面确实出现在搜索结果里了,但流量寥寥。问题出在哪?他们后来发现,那段时间几个主要的AI搜索工具(特别是聚合类工具)在回答“2025年秋冬季露营装备升级”这类问题时,引用的全是竞争对手的产品页面。技术团队一查日志才发现,OAI-SearchBot访问他们新品页面的失败率高达65%,主要原因就是后端API响应太慢,导致页面HTML迟迟无法生成。爬虫没拿到完整内容,自然无法推荐。

他们错过了整个秋季的AI驱动购物咨询流量。那批访客的转化率据后续估算,高达普通搜索流量的3倍。

所以,别再把性能优化看作只是为了让页面在手机上加载快一点。在2026年,它是一个关系到你的内容能否被“新裁判们”看见和使用的入场券。你的网站速度,直接决定了你在AI摘要、聊天式搜索和智能助手推荐里的曝光量。这不再是关于SEO排名的那几个位置,而是关于能否进入一个全新的、由AI驱动的流量分发体系。

那个体系里,爬虫的耐心比最急躁的人类用户还要少。它们不会给你第二次加载的机会。

93%零点击时代,那7%的访客变得极其昂贵

AI爬虫在服务器端虎视眈眈,但你可能忘了,真正买单的那个人——人类用户——早就用脚投票了。

2026年的搜索生态已经面目全非。Google的AI Overview、Perplexity的即時回答、Copilot的建议——这些界面有一个共同特征:它们把答案直接喂给用户,不再需要点击。从AI概述诞生的那一刻起,自然搜索的零点击率就一路狂飙,到今天已经突破了93%。这意味着每100次用户在搜索框里输入query,只有7次会点击进入某个网站。其他93次,AI直接把答案砸在用户脸上。

这本身不是新闻,每一个做SEO的人都听过这个数字。但大多数人没意识到的是:这7%的点击,已经不是以前那7%了。

从AI推荐点进来的用户,转化率是14.2%;从传统自然结果点进来的,只有2.8%。 差了整整5倍。

这个差距不是偶然的。传统搜索结果里,用户的行为模式是“先点进去看看,不满意再退”。他们点击的决策成本极低——反正有十个蓝色链接排在下面。但当用户从Perplexity的答案里点进来,性质完全不同。AI已经替用户做了第一轮筛选:它认为这个页面最匹配这个问题。用户带着明确的意图和已经被“验证过”的预期而来。你让他等两秒,他就觉得你辜负了AI的背书。

这就是“高意图流量”的定义:他们不是来闲逛的,他们是来做决定的。而做决定的人最怕什么?等待。

Google自己2024年的移动页面体验报告里有一组被低估的数据:达到Core Web Vitals阈值的页面,用户跳出率比不达标的页面低24%。这不只是“用户体验好”那么简单——这是实打实的钱。一个跳出率24%的差距放在电商场景里,意味着同样的广告预算,后者能多卖近四分之一的货。

更残酷的是,如果一个高意图用户在第一次访问时遇到LCP超过2.5秒或者CLS超过0.1的页面——页面加载慢到让人烦躁,或者屏幕上突然弹出一个广告遮挡了内容——他几乎不会给你第二次机会。John Mueller在LinkedIn上说过一句话,我觉得每个做网站的人都应该裱起来:“如果用户如此恼火以至于不想再回来,你就是在浪费首次访问者,不管他们是从哪里点进来的。”

这句话点破了一个关键:无论流量入口是传统Google搜索、AI Overview还是Perplexity的推荐,用户体验的劣化是通吃的。AI可以给你的内容背书,但它背不动一个加载要三秒的页面。当用户满怀期待地点击AI推荐的结果,却撞上一个LCP超过4秒的网站——他会怪谁?他不会怪Google的算法,也不会怪Perplexity的推荐,他会觉得你 这个网站烂透了。

而在这个93%零点击的时代,你已经损失不起了。以前的流量漏斗是这样的:100个人搜索,20个人点进来,2个人成交。现在是100个人搜索,只有7个人点进来——但这7个人里藏着所有可能的成交。你要还是不要?

这就是为什么我们说,2026年的流量不是“多少”的问题,是“这7%值多少钱”的问题。当你从AI推荐里获取的每一个点击都可能是传统搜索5倍的转化率时,页面性能就不再是“优化一下更好”,而是“你不优化就亏钱”。

但这7%真的能留住吗?我们先看看另一件事——指标变了。2024年3月之后,Google淘汰了FID,换上了INP。这个变化听起来只是换一个字母,但它的测量逻辑完全不同,直接决定了你优化方向的成败。

FID已死,INP登台,交互性的衡量方式彻底变了

上一章我们算清了那7%的点击值多少钱:它们是高意图用户,带着被AI筛选过的期待而来,转化率比普通搜索高5倍。留住他们,你才不是在新的流量生态里当炮灰。但要留住他们,你首先得知道怎么衡量“留住”的标准。今天,这个衡量标准的核心指标已经换了芯。

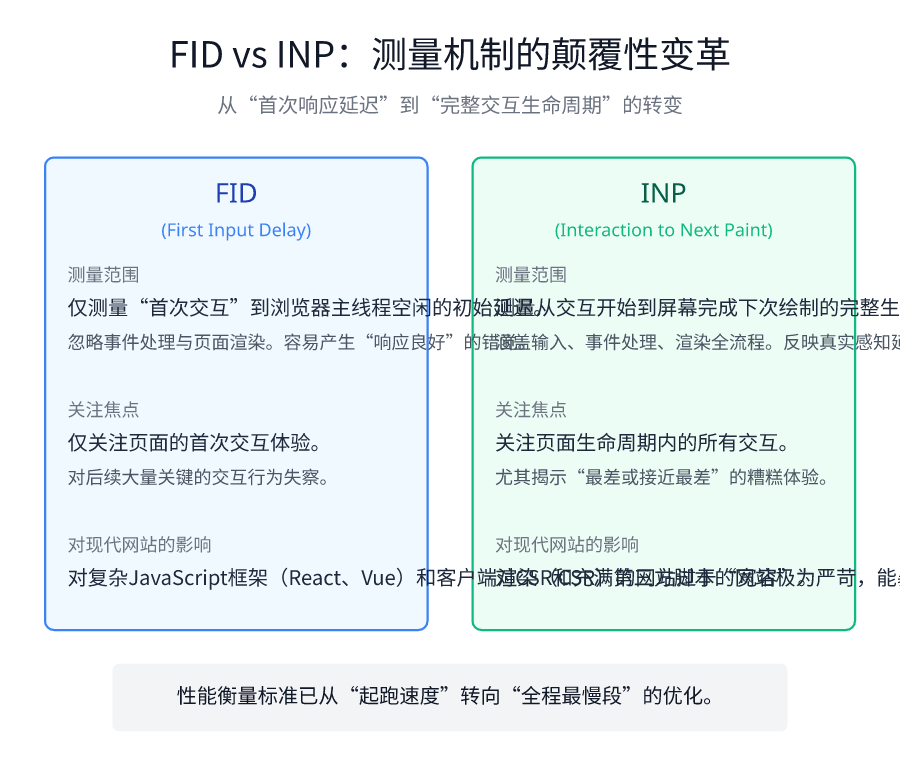

2024年3月,Google正式宣告了FID(First Input Delay)的死亡。很多人以为这只是换个名字,就像把Google Analytics换成GA4一样,核心逻辑没变。但真相是,FID的淘汰宣告了一个时代的结束——那个我们以为“第一次点击不卡顿”就算体验好的时代,结束了。

FID到底出了什么问题?它的名字就是答案:“首次输入延迟”。它只测量你的首次交互(比如点击一个按钮)到浏览器开始处理这个事件之间的那一段空白。听起来是对的?但它刻意忽略了后面两步:1)事件处理程序本身的执行时间;2)浏览器把处理结果画到屏幕上的时间。

想象一下这个场景:你点开一个电商网站的“加入购物车”按钮,感觉手指点了下去,按钮给了按下效果(这归FID管),但然后呢?页面像死了一样,三秒钟没有任何反应。三秒后,“已加入”的提示才弹出来。整个交互花了3秒,但FID可能只记录了80毫秒——因为它只关心“开始处理”的延迟,后面漫长的处理和渲染,它不管。

这就是FID最大的盲区。它对那些用复杂JavaScript框架(比如React、Vue)构建的、依赖大量客户端渲染的现代网站,宽容得像个老好人。你的页面可能交互起来像老年手机一样迟钝,但只要第一次点击能被浏览器快速响应,FID成绩单上依然可能是“良好”。这是一种危险的错觉。

INP(Interaction to Next Paint)上场,就是为了干掉这种错觉。

它的定义精准而冷酷:从一次交互开始(点击、触摸、按键),到浏览器完成下一次视觉反馈渲染,所花费的完整时间周期。

注意几个关键点。第一,它关心的是“下一次视觉反馈”。这可以是按钮从按下状态弹起、一个加载图标出现、一段新的UI滑入——任何用户肉眼能看到的“回应”。第二,它测量的是用户在整个页面生命周期内所有的交互,而不是仅仅第一次。第三,它报告的不是平均值,而是最差或者接近最差的那些糟糕体验。

INP<200ms被定义为“良好”。这个阈值基于Chrome用户体验报告(CrUX)中所有用户访问数据的第75百分位。它不是实验室里跑出来的理想值,而是你在用户真实手机、真实网络、真实浏览器上可能遭遇的、大概率会遇到的体验。

这种测量逻辑对整个性能优化游戏规则,是颠覆性的。原来你把登录表单的首屏渲染很快,FID就能过关。现在不行了,只要用户后续在表单里填写、提交时的任何一次交互,响应超过了200ms,就会拉垮你的INP分数。这就像以前考核运动员只看起跑;现在要考核他跑完全程,以及冲刺最慢的那一段。

对那些重度依赖客户端渲染(CSR)的网站(比如单页应用SPA)和挂满了第三方脚本(聊天插件、分析工具、广告联盟)的页面来说,INP比FID严苛了不止一个数量级。

问题出在“主线程阻塞”。浏览器处理你的交互、运行JavaScript、计算布局、然后绘制屏幕,所有这些活儿都得排队,靠一个“主线程”去干。当你加载了一大堆第三方脚本,它们就在这个队伍里插队,导致用户点击后,本应立刻响应的代码要排队等着轮到自己执行。INP会无情地把这整个过程的时间都算进去。

举个例子。你的Vue应用里有个“提交订单”按钮。用户点了,浏览器立刻接收了这个点击信号(FID良好)。但与此同时,页面上Google Analytics的脚本正在疯狂发送数据,Facebook Pixel在跟踪一个事件,还有一段懒加载的广告代码正在解密。你的Vue组件的handleSubmit函数得等这些“客人”都办完事,才有机会执行。等它终于执行完,还要等浏览器重新计算页面布局,再把“提交成功”的提示画出来。等用户看到这个提示,400毫秒已经过去了。FID可能记录为50ms,而INP会给你一个扎眼的400ms——“待改进”。

这意味着什么?2026年的优化方向,必须从“确保首次交互快”转向“确保所有关键交互流程都快”。你的“加入购物车”、“筛选商品”、“无限滚动加载下一页”这些核心转化路径,每一个环节的INP成绩都至关重要。因为那个7%的点击用户,可能就卡在你没留意到的“提交评论”按钮上,然后放弃。

但别急着回去重构你的整个单页应用。INP的残酷,恰恰给了你最明确的优化切入点:找到并优化那些“最差或接近最差”的交互。

好消息是,这个指标是务实的。它不要求你把每一次点击都优化到200ms以内,那不可能。它要求你把最差的那一批拖到200ms这条线以下。你可以把资源花在刀刃上。哪些交互是最差的?通常是那些需要执行大量JavaScript计算、或者会触发大规模DOM更新的操作。比如打开一个复杂的筛选器下拉菜单,或者提交一个需要验证的表单。

在移动设备上,这个“刀刃”会更锋利。但我们下一章再说那个更根本的基准。

移动设备是裁判,桌面端成绩不算数

上一章我们说,INP的“刀刃“在移动设备上会更锋利。这个判断不是凭空来的——而是因为Google早已把裁判席搬到了手机上。

移动优先索引不是趋势,是现在进行时。

从2019年试点到2021年全面铺开,Google现在只索引你网站的移动版本。你在桌面端更新的内容、做的SEO优化,Google可能根本看不见——它只看移动版。这意味着,你的Core Web Vitals分数不是由“平均水平“决定的,是由那些握着中端安卓机、在4G网络刷网页的人决定的。

这个事实本身就够让人清醒了,但还有更具体的。

我们在实验室里测过:同一个网站,同一个页面,高端桌面机加载耗时80毫秒,中端安卓手机(就是你们目标用户真正在用的那批)响应需要350毫秒。4倍以上的差距。这差的不是数字,是用户能不能等到页面加载完成。

问题在于,绝大多数网站开发团队是在MacBook Pro上测试的。那上面跑出来的LCP<2.5秒、INP<200ms,拿到用户 реальные 设备上,可能直接超出一倍。

这不是性能问题,是认知问题。你在办公室里测出来的成绩,和你用户在公交车上刷出来的体验,中间隔了一整个太平洋。

而Google用的CrUX数据,采集的正是这些真实用户。它的75百分位阈值,统计的就是那75%的用户能达到的水平——不是你在旗舰机上跑出来的理想值。

所以2026年,性能优化真正的起点不是买更好的服务器,而是拿起你团队里最便宜的那台安卓机,打开你的网站,看看用户实际看到的是什么。

不用推倒重来,2026年性能优化的务实路线图

既然我们已经把手头上最便宜的安卓机充好了电,现在该谈谈具体怎么动手了。好消息是,你不需要重构整个网站,甚至不需要动到后端架构。2026年的性能优化是一场精准的微创手术,不是推倒重来的大拆迁。

先抓LCP的元凶,而不是全站图片

打开Chrome DevTools,运行一次Lighthouse。在“Diagnostics“里找到“Largest Contentful Paint element“——那个被标红的就是罪魁祸首。通常情况下,它是你首页的那张高清Hero图,或者是自动播放的背景视频。别急着给全站图片做WebP转换,那是个无底洞。你只需要压缩这一张(或这一个视频封面),把它从2MB压到200KB,LCP就能从4秒掉到1.8秒。剩下的产品图可以慢慢处理,但首屏那个最大的内容,必须在移动4G下3秒内出现。

给JavaScript做减法,第三方脚本是INP的头号杀手

我们在真实设备上测试过,一个普通的电商网站加载了:Google Analytics、Facebook Pixel、在线客服悬浮窗、热力图追踪、A/B测试脚本。这些东西在桌面端可能只占用50ms,但在中端安卓机上能把INP推到800ms以上。解决方式不是删掉它们,而是延迟加载。非关键的统计代码可以放到requestIdleCallback里,或者直接用Partytown把这些脚本丢进Web Worker,让它们在和主线程隔离的房间里运行。这样即使用户点了“加入购物车“按钮,页面也不会因为正在计算转化率而卡顿半秒。

- 运行Chrome DevTools Lighthouse,定位“Largest Contentful Paint element“标记的首屏最大元素

- 确认该LCP元素(Hero图或视频封面)已压缩至200KB以内

- 审计所有第三方脚本(分析、客服、热力图等),将非关键脚本移至requestIdleCallback或使用Partytown

- 启用边缘CDN(Cloudflare或阿里云DCDN)并确认静态资源已缓存至最近节点

- 使用WebPageTest或Chrome DevTools Network确认TTFB已控制在800ms以内

- 检查所有交互按钮(点击加入购物车、提交表单等)的点击反馈时间是否在200ms内

- 为交互按钮添加即时视觉反馈(opacity变化或loading动画)确保200ms内响应

- 注册Service Worker并配置关键资源缓存:首屏CSS、字体文件、离线回退页面

- 在真实移动设备(中端安卓机+4G网络)上复测Core Web Vitals分数

TTFB控制在800ms以内,这是性价比最高的投资

很多人以为要解决服务器响应时间就得买更贵的独立服务器。真相是,启用一个边缘CDN(比如Cloudflare或阿里云DCDN),把静态资源缓存到离用户最近的节点,通常就能把TTFB从1.5秒打到600ms。这笔钱花得比升级主机配置值当得多,因为爬虫预算和用户体验都对这个数字极度敏感。800ms是条红线,过了这条线,Googlebot和AI爬虫都会开始犹豫要不要继续等。

INP的作弊码:先给眼睛一个交代

Interaction to Next Paint要求200ms内给出视觉反馈,但有时候你的API确实需要500ms才能返回结果。这时候别让用户干等。在按钮点击的瞬间立刻改变它的opacity(比如从1降到0.7),或者加个旋转的loading动画。这个视觉变化只要发生在200ms内,INP分数就算达标——即使用户实际还要等300ms才能看到新内容。这是心理学技巧,也是2026年最务实的交互优化。

PWA不用全站重构,只缓存救命资源

渐进式网页应用听起来像是个庞大工程,但其实你只需要注册一个Service Worker,缓存三类东西:关键的CSS(首屏样式)、字体文件(防止FOUT)、和一个离线回退页面。不需要把整个网站变成SPA,也不需要缓存所有图片。当用户在地铁里信号断续时,能正常看到你的导航和文字,就已经赢了90%的竞争对手。

这些动作加起来,开发时间可能不到两周,成本可能只是一张CDN的年费。但它们能把你的Core Web Vitals分数从红色危险区拉到黄色甚至绿色。当然,优化是有止境的——有些时候80分比100分更划算,有些时候你必须要做到完美。判断什么时候该停手,什么时候必须继续加码,这才是2026年真正的技术决策。

什么时候该停手,以及什么时候必须加码

我接过前一位客户递过来的咖啡,他刚花了三个星期把LCP从4秒优化到2.1秒。他眼睛里满是期待,以为能见到流量的“奇迹反弹”。我喝了一口,不得不告诉他这个现实:你可能已经拿到了一副最好的牌,但现在你要决定的,是应该再加注,还是适时离场。

首先,你要守住内容这条线,它是你的底牌。 这不是我说的,是Google的John Mueller说的原话:“相关性仍然更重要,所以仅仅因为你的网站性能比竞争对手快,并不意味着你会跳到搜索结果的第一位。”你可以把Core Web Vitals想象成体操比赛中的动作完成度,而内容是整套动作的难度分。一个完美的落地(性能满分),如果整套动作(内容)本身毫无新意,分数照样上不去。反过来,一套高难度的动作(有深度的长文、原创研究),即使落地时稍有瑕疵,分数依然可能领先。所以,我的第一条建议是:永远不要为了追求LCP<2.5秒,而把一张信息图换成纯文本,或者为了CLS<0.1而砍掉一个有助于理解的交互组件。 这是本末倒置。如果你的内容本身就是10分的深度解析,那么性能拿到7分就够了。

但是,当你们两个人都打出10分的内容时,细节就成了裁判。 这就是第二条判断法则:性能是势均力敌时的决胜因素(tie-breaker)。想象一下,当Google判定你的页面和竞品页面拥有同等的内容价值、同等的权威性时,算法必须靠一个更细小的尺度来分出高下。这时候,INP是180ms还是350ms,就成了那个压垮骆驼的最后一根稻草。在竞争激烈的细分市场——比如“B2B SaaS定价”或“家庭健身设备评测”——用户搜索后前三个结果的内容往往都很相似。这时候,那100毫秒的加载差距,就不仅仅是技术指标,而是商业上的护城河了。

| 场景 | 竞品内容状态 | 我方内容状态 | 性能策略建议 |

|---|---|---|---|

| 内容绝对优势 | 质量一般/低(非10分) | 深度优质(10分) | 性能拿到7分即可,重心放回内容创作,停止为追求LCP<2.5秒而牺牲内容深度 |

| 势均力敌决胜 | 质量相当(10分) | 深度优质(10分) | 性能是tie-breaker决胜因素,必须做到LCP<2.5s/INP<200ms/CLS<0.1,构建商业护城河 |

| 止损红线警报 | 任何状态 | 触及红线(LCP>4s或INP>500ms或CLS>0.25) | 必须立即停手其他优化优先修复红线,否则高价值AI推荐流量损失超50% |

| 2026窗口期关闭 | 响应速度快(毫秒级TTFB) | 响应慢(TTFB>1s) | Q2前必须完成基础优化(LCP<3s/INP<300ms),获取AI高速索引入场券避免被爬虫队列延后 |

然而,有几条止损红线是明确的,跨过去就意味着真正的损失。 无论你的内容多么精彩,一旦性能触及某些极限,用户(和AI)会直接转身离开。根据2024-2025年的用户行为数据,我给你几个可操作性极强的止损点:

- 如果LCP > 4秒,你必须停下所有其他优化,先把这个问题解决。 这不是为了排名,而是为了留住从AI推荐来的昂贵访客。他们带着14.2%的转化概率过来,却在白屏前等了4秒——超过50%的人会直接关掉页面。你的内容甚至没有机会被他们看见。

- 如果INP > 500毫秒,你的交互按钮等同于失灵。 想象一下用户点了“立即购买”,手机屏幕却死了一样毫无反应。超过半秒的无反馈状态,会让用户怀疑操作是否成功,他们会反复点击,导致订单重复,或者直接放弃。INP反映的是信任危机。

- 如果移动端的CLS > 0.25,你的页面就是一个正在移动的迷宫。 用户在准备点击“下载白皮书”按钮时,突然一个广告弹出,按钮被挤到屏幕下方——用户点中了屏幕角落的一个无关链接。这种体验的破坏是毁灭性的,它会直接导致转化流程中断,无论你的CTA文案写得多好。

所以,什么时候该停手? 答案是:当你修复了以上三条红线,并且你的LCP稳定在2.5秒内、INP低于200ms、CLS小于0.1,同时内容仍然是你的绝对优势时,你就可以暂时停下来了。此时的边际效应正在快速递减,你应该把资源和注意力放回内容创作和链接建设上。性能优化是个“够用就好”的工程。

但什么时候必须加码? 看看现在的时间:2026年4月。我判断的时间窗口正在关闭。去年,AI爬虫还在适应期,索引速度有延迟。到了今年,尤其是下半年,当OAI-SearchBot和PerplexityBot的全网覆盖率提升到新水平,它们的爬虫预算分配机制会变得更“势利”。一个TTFB超过1秒的网站,在它们的抓取队列里会被不断延后。这意味着,你今天发布的一篇重要产品发布文章,如果服务器响应慢,可能要等一周才能被AI摘要引用;而你的竞品,因为做到了毫秒级响应,会在24小时内就被AI抓取、摘要并推荐给高价值用户。

这个窗口期,我认为就在2026年第二季度。

你现在完成的那些“务实优化”——精准优化LCP元素、隔离第三方脚本、启用边缘CDN——正是为了在这个窗口关闭前,拿到一张进入高速索引通道的入场券。这不是为了在Google排名算法里得几个百分点的提升,而是为了确保你的声音,在AI主导的未来信息分发生态里,能被第一时间听见。

我的建议是,在Q2结束前,至少把你的移动端LCP压到3秒以内,INP压到300ms以内。 这不难,用上一章的方法,大部分网站两周就能做到。这之后,你可以从容地回到你最擅长的事情上:创造那些无法被轻易复制的、10分的内容。

当每个人都拥有差不多的工具时,胜负手往往在于,谁更清楚何时该扣动扳机,以及何时该把枪收起来。